YouTube’daki bu videoya aman dikkat! Onun da görüntüsü ve sesi kullanıldı! Esra Erol uyardı

Gündüz kuşağının sevilen ve takip edilen isimlerinden Esra Erol, artık yapay zeka dolandırıcılarının hedefi haline geldi. Esra Erol’un daha önce çekilmiş bir videosuna yapay zeka kullanılarak yeniden dublaj yapıldı. Görüntüsü ve sesi kullanılarak insanların kandırıldığını öğrenen Erol, sosyal medya hesabından takipçilerini uyardı.

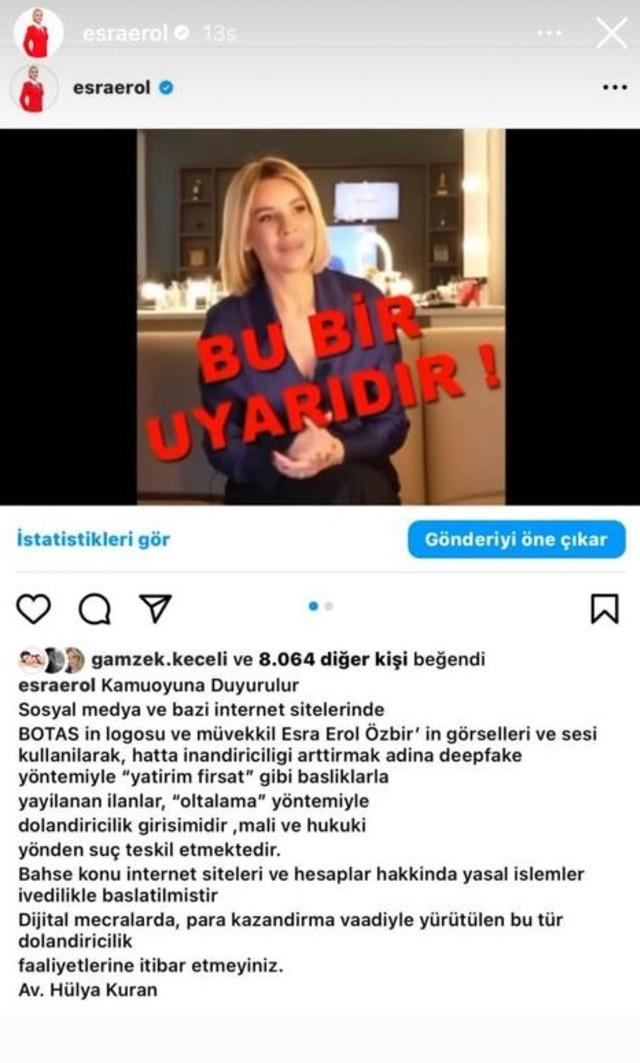

Konuşmasının yapay zeka yöntemi kullanılarak düzenlendiğini öğrenen Esra Erol, dolandırıcıların hazırladığı görseli ve videonun orijinal versiyonunu Instagram hesabında paylaştı.

Hukuki yola başvuran Esra Erol’un avukatı Hülya Kuran, yaptığı yazılı açıklamada şunları söyledi: “Kamuoyuna duyurulmuştur… Sosyal medyada ve bazı internet sitelerinde BOTAŞ logosu ve müvekkil Esra Erol Özbir’in görselleri ve sesinin kullanılması, Ayrıca kredibiliteyi artırmak için deepfake yöntemi kullanılarak “yatırım fırsatı” yaratıldı. “” gibi başlıklarla yayınlanan reklamlar, phishing yöntemiyle dolandırıcılığa teşebbüstür. Mali ve hukuki suç teşkil etmektedir. Hakkında yasal işlem derhal başlatılmıştır. Söz konusu web siteleri ve hesaplara para kazanma vaadiyle dijital ortamda gerçekleştirilen bu tür dolandırıcılık faaliyetlerine itibar etmeyiniz.”

“4 milyon TL değerindeki pırlanta alyans ve bilekliği nasıl aldınız?” Suçlamalara yanıt

“4 milyon TL değerindeki pırlanta alyans ve bilekliği nasıl aldınız?” Suçlamalara yanıt Ünlü sunucu Ali Kırca’ya büyük şok! Polis müdahale etti

Ünlü sunucu Ali Kırca’ya büyük şok! Polis müdahale etti Ödül üstüne ödül aldı! Olay yorumlandı

Ödül üstüne ödül aldı! Olay yorumlandı